Описание

Я пытаюсь развернуть один из предварительно подготовленных Модели обнаружения объектов TensorFlow (faster_rcnn_inception_v2_coco_2018_01_28) в службе TF. Я выполняю следующие шаги:

- Клонировать https://github.com/tensorflow/models

- Загрузите предварительно обученную модель контрольной точки

- Экспортируйте Inception, как описано здесь с помощью этой команды. . Примечание. Я меняю

input_typeнаencoded_image_string_tensor, чтобы мне не нужно было прикреплять входной тензор для десериализации входной строки в API. - Преобразуйте Inception из предыдущего шага в обслуживаемый с помощью кода ниже

- Запустите TF Serving, указав

model_base_pathна папку, созданную на предыдущем шаге.

Проблема

При запросе конечной точки API predict происходит сбой, похоже, что модель не была правильно инициализирована:

{ "error": "Attempting to use uninitialized value SecondStageFeatureExtractor/InceptionV2/Mixed_5c/Branch_3/Conv2d_0b_1x1/BatchNorm/moving_mean\\n\\t [[Node: SecondStageFeatureExtractor/InceptionV2/Mixed_5c/Branch_3/Conv2d_0b_1x1/BatchNorm/moving_mean/read = Identity[T=DT_FLOAT, _output_shapes=[[128]], _device=\\"/job:localhost/replica:0/task:0/device:CPU:0\\"](SecondStageFeatureExtractor/InceptionV2/Mixed_5c/Branch_3/Conv2d_0b_1x1/BatchNorm/moving_mean)]]" }

Действительно, журнал обслуживания TF предупредил The specified SavedModel has no variables; no checkpoints were restored. (см. Приложение к Шагу 5).

Что мне не хватает на этапе экспорта модели? Из более старых выпусков (this и this), я вижу, это может быть связано с тем, что на шаге (3) переменные замораживаются как константы в сохраненной модели. Так ли это?

Приложение к Шагу 3 - Начало реэкспорта

python object_detection/export_inference_graph.py \

--input_type encoded_image_string_tensor \

--pipeline_config_path ${MODEL_DIR}/pipeline.config \

--trained_checkpoint_prefix ${MODEL_DIR}/model.ckpt \

--inference_graph_path ${MODEL_DIR} \

--export_as_saved_model=True \

--write_inference_graph=True \

--output_directory ${OUTPUT_DIR}

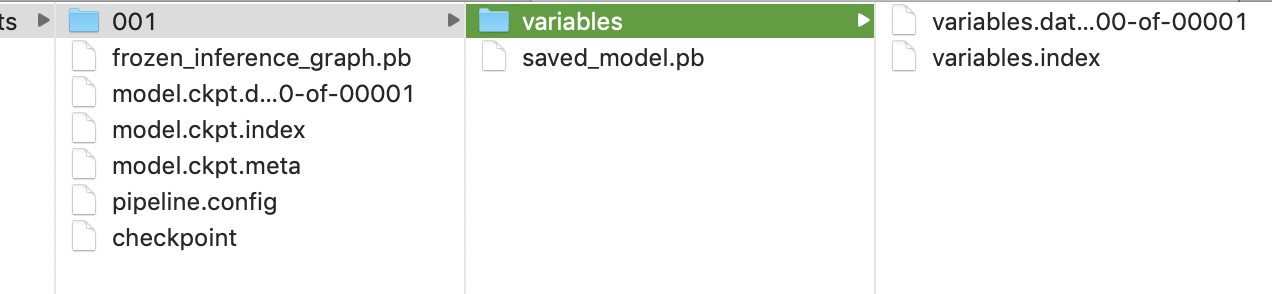

Эта команда производит эту модель

MetaGraphDef with tag-set: 'serve' contains the following SignatureDefs:

signature_def['serving_default']:

The given SavedModel SignatureDef contains the following input(s):

inputs['inputs'] tensor_info:

dtype: DT_STRING

shape: (-1)

name: encoded_image_string_tensor:0

The given SavedModel SignatureDef contains the following output(s):

outputs['detection_boxes'] tensor_info:

dtype: DT_FLOAT

shape: (-1, 100, 4)

name: detection_boxes:0

outputs['detection_classes'] tensor_info:

dtype: DT_FLOAT

shape: (-1, 100)

name: detection_classes:0

outputs['detection_scores'] tensor_info:

dtype: DT_FLOAT

shape: (-1, 100)

name: detection_scores:0

outputs['num_detections'] tensor_info:

dtype: DT_FLOAT

shape: (-1)

name: num_detections:0

Method name is: tensorflow/serving/predict

Приложение к шагу 4 - Сохраненная модель в доступную для просмотра

import os

import shutil

import tensorflow as tf

tf.app.flags.DEFINE_string('checkpoint_dir', '/tmp/inception_train',

"""Directory where to read training checkpoints.""")

tf.app.flags.DEFINE_string('output_dir', '/tmp/faster_rcnn_inception_v2_coco_2018_01_28-export/',

"""Directory where to export inference model.""")

tf.app.flags.DEFINE_integer('model_version', 1,

"""Version number of the model.""")

tf.app.flags.DEFINE_string('summaries_dir', '/tmp/tensorboard_data',

"""Directory where to store tensorboard data.""")

FLAGS = tf.app.flags.FLAGS

def main(_):

with tf.Graph().as_default() as graph:

saver = tf.train.import_meta_graph(meta_graph_or_file=os.path.join(FLAGS.checkpoint_dir, 'model.ckpt.meta'))

with tf.Session(graph=graph) as sess:

saver.restore(sess, tf.train.latest_checkpoint(FLAGS.checkpoint_dir))

# (re-)create export directory

export_path = os.path.join(

tf.compat.as_bytes(FLAGS.output_dir),

tf.compat.as_bytes(str(FLAGS.model_version)))

if os.path.exists(export_path):

shutil.rmtree(export_path)

tf.global_variables_initializer().run()

tf.local_variables_initializer().run()

print("tf.global_variables()")

print(sess.run(tf.global_variables()))

print("tf.local_variables()")

print(sess.run(tf.local_variables()))

# create model builder

builder = tf.saved_model.builder.SavedModelBuilder(export_path)

# Build the signature_def_map.

predict_inputs_tensor_info = tf.saved_model.utils.build_tensor_info(graph.get_tensor_by_name('encoded_image_string_tensor:0'))

boxes_output_tensor_info = tf.saved_model.utils.build_tensor_info(graph.get_tensor_by_name('detection_boxes:0'))

prediction_signature = (

tf.saved_model.signature_def_utils.build_signature_def(

inputs={

'images': predict_inputs_tensor_info

},

outputs={

'classes': boxes_output_tensor_info

},

method_name=tf.saved_model.signature_constants.

PREDICT_METHOD_NAME

)

)

builder.add_meta_graph_and_variables(sess,

[tf.saved_model.tag_constants.SERVING],

signature_def_map={

tf.saved_model.signature_constants.

DEFAULT_SERVING_SIGNATURE_DEF_KEY:

prediction_signature,

},

legacy_init_op=None)

builder.save(as_text=False)

merged = tf.summary.merge_all()

train_writer = tf.summary.FileWriter(FLAGS.summaries_dir + '/' + str(FLAGS.model_version),

sess.graph)

print("Successfully exported Faster RCNN Inception model version '{}' into '{}'".format(

FLAGS.model_version, FLAGS.output_dir))

if __name__ == '__main__':

tf.app.run()

Это приводит к следующему обслуживаемому:

MetaGraphDef with tag-set: 'serve' contains the following SignatureDefs:

signature_def['serving_default']:

The given SavedModel SignatureDef contains the following input(s):

inputs['images'] tensor_info:

dtype: DT_STRING

shape: (-1)

name: encoded_image_string_tensor:0

The given SavedModel SignatureDef contains the following output(s):

outputs['classes'] tensor_info:

dtype: DT_FLOAT

shape: unknown_rank

name: detection_boxes:0

Method name is: tensorflow/serving/predict

Приложение к шагу 5 - журнал docker-compose для развертывания обслуживаемого

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.191941: I tensorflow_serving/model_servers/main.cc:153] Building single TensorFlow model file config: model_name: faster_rcnn_inception model_base_path: /tmp/faster_rcnn_inception_v2_coco_2018_01_28_string_input_version-export/

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.192341: I tensorflow_serving/model_servers/server_core.cc:459] Adding/updating models.

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.192465: I tensorflow_serving/model_servers/server_core.cc:514] (Re-)adding model: faster_rcnn_inception

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.195056: I tensorflow_serving/core/basic_manager.cc:716] Successfully reserved resources to load servable {name: faster_rcnn_inception version: 1}

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.195241: I tensorflow_serving/core/loader_harness.cc:66] Approving load for servable version {name: faster_rcnn_inception version: 1}

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.195404: I tensorflow_serving/core/loader_harness.cc:74] Loading servable version {name: faster_rcnn_inception version: 1}

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.195652: I external/org_tensorflow/tensorflow/contrib/session_bundle/bundle_shim.cc:360] Attempting to load native SavedModelBundle in bundle-shim from: /tmp/faster_rcnn_inception_v2_coco_2018_01_28_string_input_version-export/1

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.195829: I external/org_tensorflow/tensorflow/cc/saved_model/loader.cc:242] Loading SavedModel with tags: { serve }; from: /tmp/faster_rcnn_inception_v2_coco_2018_01_28_string_input_version-export/1

tf-serving-base exited with code 0

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.313633: I external/org_tensorflow/tensorflow/core/platform/cpu_feature_guard.cc:141] Your CPU supports instructions that this TensorFlow binary was not compiled to use: AVX2 FMA

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.492904: I external/org_tensorflow/tensorflow/cc/saved_model/loader.cc:161] Restoring SavedModel bundle.

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.493224: I external/org_tensorflow/tensorflow/cc/saved_model/loader.cc:171] The specified SavedModel has no variables; no checkpoints were restored.

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.493329: I external/org_tensorflow/tensorflow/cc/saved_model/loader.cc:196] Running LegacyInitOp on SavedModel bundle.

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.512745: I external/org_tensorflow/tensorflow/cc/saved_model/loader.cc:291] SavedModel load for tags { serve }; Status: success. Took 316614 microseconds.

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.513085: I tensorflow_serving/servables/tensorflow/saved_model_warmup.cc:83] No warmup data file found at /tmp/faster_rcnn_inception_v2_coco_2018_01_28_string_input_version-export/1/assets.extra/tf_serving_warmup_requests

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.513927: I tensorflow_serving/core/loader_harness.cc:86] Successfully loaded servable version {name: faster_rcnn_inception version: 1}

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.516875: I tensorflow_serving/model_servers/main.cc:323] Running ModelServer at 0.0.0.0:8500 ...

tf-serving-faster_rcnn_inception | [warn] getaddrinfo: address family for nodename not supported

tf-serving-faster_rcnn_inception | 2018-08-16 16:05:28.518018: I tensorflow_serving/model_servers/main.cc:333] Exporting HTTP/REST API at:localhost:8501 ...

tf-serving-faster_rcnn_inception | [evhttp_server.cc : 235] RAW: Entering the event loop ...

Примечания:

- питон 2.7

- тензорный поток 1.10.0 на обоих этапах (3), (4) и (5). Устанавливается через пипс.